Wie sieht eine Welt aus, in der du deinen eigenen Augen nicht mehr trauen kannst? Künstliche Intelligenz schafft es dank ihrer Algorithmen, überzeugend echt Videos zu faken. Es fällt immer schwerer, sogenannte „Deepfakes” von der Realität zu unterscheiden – das birgt riesige Gefahren für Politik und Finanzmärkte.

Stell dir vor, du wachst morgens auf und siehst dein Gesicht landesweit in den Nachrichtenmedien. Der Grund: Eine Rede, die du nie wirklich gehalten hast. Sie wurde auf überzeugende Art gefälscht und missbraucht dein Gesicht dazu, eine fremde Meinung zu propagieren. So erging es der belgischen Politikerin Sophie Wilmès, die 2020 Opfer eines Deepfakes wurde.

Wie generiert eine Deepfake Software gefälschte Videos?

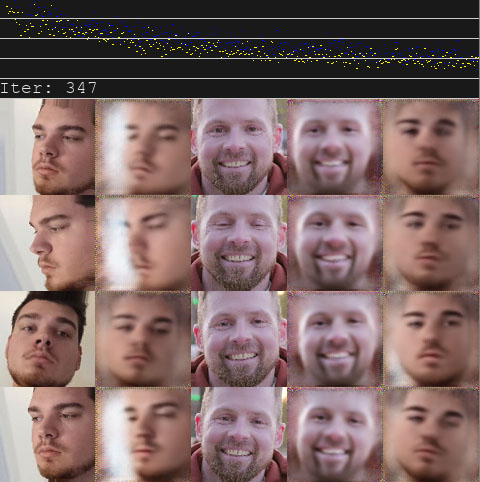

Im Grunde wird bei Deepfake Videos das Gesicht der dargestellten Person durch ein anderes Gesicht ausgetauscht. Deepfakes werden mit Hilfe eines neuronalen Netzwerks generiert, welches die Gesichter der Ziel- und Quellvideos miteinander vergleicht. Anschließend entscheidet es, welche Gesichtsausdrücke, die in den beiden Videos zu sehen sind, sich besonders ähneln. Um das zu erreichen, erkennt ein Algorithmus Muster in beiden Gesichtern, indem es sich sogenannte „Landmarks“, wie beispielsweise Augen, die Nase oder den Mund sucht.

Vereinfacht kann man sagen, dass das neuronale Netzwerk passende Gesichtsausdrücke im Quellvideo sucht, um diese dann an korrekter Stelle im Zielvideo einzusetzen. Hierzu erstellt das neuronale Netzwerk sogenannte „Face Sets”, die möglichst viele verschiedene Perspektiven des Gesichts sammeln und abbilden sollen.

Je mehr Daten man in die Deepfake Software einspeist, desto realistischer kann ein Video durch die hohe Vielfalt an Gesichtsausdrücken aussehen. Deepfakes begrenzen sich übrigens nicht nur auf Videomaterial: Die Qualität von Audio Deepfakes wird immer besser und stellt in Kombination den gefälschten Videos eine Möglichkeit dar, nahezu perfekte Fakes zu kreieren.

Wie schaden Deepfakes Einzelpersonen oder der Gesellschaft?

An und für sich richten Deepfake Videos keinen Schaden an. Das beweisen beliebte Unterhaltungsapps, die beispielsweise die Gesichter ihrer Nutzer*innen passend zur Musik mitsingen lassen. Entscheidet sich aber jemand aus krimineller Energie heraus, mit gefälschten Videos einen großen Schaden anrichten zu wollen, sind die Möglichkeiten bedauerlicherweise nahezu grenzenlos. Die größte Stärke von Deepfakes ist gleichermaßen ihre größte Gefahr: Gute Deepfakes können kaum von echten Videos unterschieden werden.

Von Personen des öffentlichen Lebens wie beispielsweise Politikern, Celebrities oder Reportern existiert eine große Menge an Bild- und Filmmaterial, mit welchem ein neuronales Netzwerk trainiert werden könnte, um möglichst überzeugende Deepfakes zu generieren. Diese Menschengruppen haben gleichzeitig einen großen Einfluss auf diplomatische Beziehungen, Aktienkurse oder auch die politische Gesinnung ihres Publikums. Man kann sich ausmalen, welche Folgen ein realistisches, aber gefälschtes Interview mit einem Politiker haben könnte. Auf diese Weise ist es möglich, ganze Wahlen durch ein einziges, virales Deepfake Video zu manipulieren.

Diskreditiert durch einen Deepfake: Die Geschichte der Reporterin Rana Ayyub

Sie kämpft für Gerechtigkeit in ihrem Land – Rana Ayyub ist eine indische Reporterin, die hinter die Fassade der indischen Regierung blickt, um deren düstere Machenschaften aufzudecken. Die Wut indischer Autoritäten wuchs, nachdem Ayyub 2016 „Gujarat Files”, ein Enthüllungsbuch über den Mord an Muslimen und Hindus veröffentlichte. In Folge dessen wurde Rana Ayyub Opfer eines Deepfakes, bei dem ihr Gesicht in pornographische Inhalte montiert wurde. Daraufhin erhielt sie auch noch Jahre nach Veröffentlichung des Videos Mord- und Vergewaltigungsandrohungen.

Wie sich Deepfakes im Netz verbreiten

Wusstest du, dass sieben der zehn erfolgreichsten Facebook Beiträge über Angela Merkel komplett erfunden sind? Das fand Buzzfeed im Rahmen einer Analyse von Beiträgen über die ehemalige Bundeskanzlerin heraus. Dabei handelt es sich übrigens nicht um Deepfakes, sondern meistens um Artikel unseriöser Quellen oder missverstandene Satire.

Dass es Nutzer*innen von sozialen Medien oft schwer fällt, Fake News zu erkennen, ist kein Geheimnis. Die „Stiftung neue Verantwortung” konnte in einer ihrer Studien feststellen, dass nur 59 Prozent der Befragten dazu in der Lage waren, die Vertrauenswürdigkeit einer Quelle richtig einzuschätzen. Dabei wird hier allerdings von Artikeln und Beiträgen in schriftlicher Form berichtet. Den Wahrheitsgehalt eines Videos einzuschätzen, welches realitätsnah gefälscht wurde, dürfte deshalb umso schwieriger fallen.

Was kann man gegen Deepfake Videos tun?

Große Unternehmen arbeiten bereits gemeinsam mit Forschern daran, das Problem von Deepfakes in den Griff zu bekommen: Facebook setzt beispielsweise schon Algorithmen ein, die mit Hilfe von künstlicher Intelligenz dazu in der Lage sind, Deepfakes zu erkennen.

Wie enttarne ich Deepfakes?

- Auffälligkeiten beim Übergang zwischen Kopf und Hintergrund: Beispielsweise verwischte Konturen

- Ungewöhnliche Verzerrungen im Hintergrund

- Lichtreflektionen aus unterschiedlichen Richtungen

- Fehler in der Darstellung von Zähnen: Überlappungen oder falsche Positionierung einzelner Zähne

- Inkonsistenz zwischen Umgebungslicht und Hautton der dargestellten Person

- Video weist bei verlangsamter Wiedergabe Darstellungsfehler auf

Abschließende Gedanken

Deepfakes sind dazu in der Lage einen großen Schaden anzurichten, wenn sie richtig eingesetzt werden. Mittlerweile können gefälschte Videos aber mit ihren eigenen Waffen geschlagen werden: Unter Verwendung von künstlicher Intelligenz gelingt es, Deepfakes frühzeitig zu erkennen und schon beim Upload zu blockieren, bevor diese viral gehen können. Nichtsdestotrotz wird man sich in naher Zukunft immer wieder die Frage stellen müssen: „Ist das Video, das ich mir gerade ansehe wirklich echt, oder einfach nur ein Fake?”

Textquellen

- What is a deepfake? Everything you need to know about the AI-powered fake media (Business Insider)

- What ‘deepfakes’ are and how they may be dangerous (CNBC)

- ‚While I’m Alive, I’ll Keep Speaking.‘ Journalist Rana Ayyub’s Fight to Expose the Truth in India (Time)

- Wie sich Fake News verbreiten (Klickwinkel)

- 7 der 10 erfolgreichsten Artikel über Angela Merkel auf Facebook sind Fake News (Buzz Feed)

- „Quelle: Internet“? Digitale Nachrichten- und Informationskompetenzen der deutschen Bevölkerung im Test (Stiftung Neue Verantwortung)

- Deepfake Detection Challenge Results: An open initiative to advance AI (Facebook)

- DARPA Is Taking On the Deepfake Problem (Nextgov)

- Ted Talks Daily, Danielle Citron: How deepfakes undermine truth and threaten democracy (abgerufen über YouTube)

- Wenn das Gehör sich täuscht (idw – Informationsdienst Wissenschaft)

- Don’t Trust Your Eyes: Image Manipulation in the Age of DeepFakes (Frontiers in Communication)

- Audio-Deepfakes: Wenn das Gehör sich täuscht (Regiotrends)

Bild- und Videoquellen

- Beitragsbild: Software DeepFaceLab, Videomaterial von fauxels von Pexels

- Abbildung 1: Software DeepFaceLab, eigenes Videomaterial gemischt mit Videomaterial von fauxels von Pexels

- Abbildung 2: Software DeepFaceLab, eigenes Videomaterial